Novinky

Tyto novinky můžete číst jako RSS.

Pozvánka na webinář Úvod do možností využití MetaCentra

.png)

Srdečně vás zveme na úvodní webinář z nové série on-line setkání, která jsou zaměřena na praktické využití výpočetní infrastruktury MetaCentrum.

Ať už jste našimi dlouholetými uživateli, teprve začínáte, nebo o využití MetaCentra teprve uvažujete, tento webinář vám pomůže zorientovat se v nabízených službách a ukáže vám, jak je využívat na maximum.

Program webináře:

- Přehled klíčových služeb dostupných v rámci MetaCentra

- Vysvětlení rozdílů mezi jednotlivými způsoby práce

- Představení interaktivních webových platforem OnDemand a Galaxy

- Práce v prostředí MetaCentra přes příkazovou řádku

- Dostupné AI nástroje a chatboti pro podporu výpočtů

- Datové úložiště S3 pro bezpečné ukládání a správu dat

- Praktické ukázky a živé demo

- Diskuse a zodpovězení dotazů

Předpokládaná délka: 60 minut + diskuze.

Webinář je vhodný pro vědecké pracovníky, studenty, IT specialisty a správce z akademického a výzkumného sektoru, kteří mají přístup k infrastruktuře MetaCentrum nebo o jeho využití uvažují. Víte o kolegovi nebo kolegyni, kterým by se naše výpočetní kapacita hodila, ale ještě nás neznají? Přepošlete jim prosím tuto pozvánku.

Registrace a více informací: https://events.cesnet.cz/e/meta1

O nové sérii webinářů

Tímto setkáním otevíráme pravidelný cyklus. Každý měsíc vám představíme jedno konkrétní téma podle vašeho zájmu. Chtěli byste se o něčem v MetaCentru dozvědět více? Budeme rádi, když nám dáte vědět, co by vás zajímalo příště.

Těšíme se na vaši účast!

Tým MetaCentra

Ivana Křenková, Thu May 28 21:40:00 CEST 2026

Bezpečnostní záplaty pro zranitelnosti "Copy Fail" a "Copy Fail 2 Dirtyfrag"

V uplynulém týdnu se v linuxovém světě objevily dvě nepříjemné zranitelnosti, souhrnně označované jako Copy Fail a Copy Fail 2 Dirtyfrag. Obě chyby se týkají způsobu, jakým jádro (kernel) manipuluje s pamětí a cache, a představují riziko zejména pro víceuživatelské systémy a kontejnerová prostředí.

O co jde?

Tato dvojice zranitelností využívá logických chyb v Linuxovém jádře, které se v systémech objevovaly postupně od roku 2017.

- Společné riziko: Obě chyby umožňují lokálnímu útočníkovi eskalovat oprávnění na úroveň root a získat tak plnou kontrolu nad systémem.

- Rozdílné exploity: Rozdíl mezi nimi je patrný především v publikovaných způsobech zneužití (exploitech). Zatímco první exploit demonstruje cestu přes úpravu binárního souboru

su, druhý útočí skrze manipulaci se systémovým souborem/etc/passwd.

Dopad je zásadní pro:

- HPC uzly: Kde na jednom stroji běží úlohy více uživatelů.

- Kontejnery, cloud: Vzhledem k tomu, že

page cacheje sdílena napříč celým operačním systémem, umožňují tyto chyby útočníkovi kompromitovat hostitelský stroj i zevnitř kontejneru.

Aktuální stav v MetaCentru

Naši administrátoři situaci nepodcenili a okamžitě zahájili údržbu:

- Námi spravované stroje (HPC, OpenStack Cloud, Kubernetes): Všechny servery v přímé správě MetaCentra (čelní uzly, výpočetní stroje, úložné servery) již byly aktualizovány a restartovány. Zde jste v bezpečí a nemusíte nic podnikat.

- Uživatelské servery (OpenStack a VMware): U serverů a instancí, které si spravujete sami (máte k nim root přístup), je nutné provést aktualizaci jádra a restart svépomocí.

DŮLEŽITÉ: Administrátoři MetaCentra nemají přístup do vašich soukromých cloudových instancí. Prosíme, proveďte aktualizaci jádra a restart svých serverů co nejdříve.

Odkazy na běžné distribuce:

- Debian: Security Tracker CVE-2026-31431

- Red Hat Enterprise Linux: RHEL Security Portal

- SUSE: SUSE CVE Database

- Ubuntu: Ubuntu Security Notices

Ivana Křenková, Mon May 11 21:40:00 CEST 2026

Dokončení upgrade frontendu skirit a skirit-lite

Vážení uživatelé,

významný upgrade frontendu skirit na novém HW byl dokončen. Zároveň je k dispozici odlehčená verze frontendu skirit-lite

Nový frontend skirit: Plný výkon na novém HW

Hlavní frontend skirit.metacentrum.cz ( aliasy skirit.ics.muni.cz, skirit.grid.cesnet.cz) již běží na novém výkonnějším HW. Toto je primární adresa, kterou doporučujeme používat pro všechna spojení.

Nový frontend skirit-lite pro nenáročné úkoly

Původní hardware frontendu skirit nekončí, ale mění svou roli. Pod novým názvem skirit-lite.metacentrum.cz bude sloužit jako „lehký” frontend (alias skirit-lite.ics.muni.cz)

- Kdy použít Skirit-Lite? Je ideální pro rychlou správu úloh, editaci skriptů nebo kontrolu stavu výpočtů.

- Kdy použít standardní Skirit? Pro náročnější interaktivní práci a operace vyžadující vyšší výpočetní výkon samotného frontendu.

Důležité informace k migraci

Změna SSH klíčů: V souvislosti s přejmenováním a výměnou HW vás může váš SSH klient upozornit na změnu otisků (host keys). To je v tomto případě očekávané chování. Seznam SSH klíčů můžete ověřit v dokumentaci https://docs.metacentrum.cz/en/docs/access/security/connect-auth

Ivana Křenková, Thu May 07 21:40:00 CEST 2026

Upgrade diskového pole projektu ELIXIR v Praze

Úspěšně jsme dokončili plánovaný upgrade diskového pole storage-praha5-elixir. Díky této investici se celková dostupná kapacita rozrostla o úctyhodný 1 PB.

Toto navýšení pocítí zejména uživatelé zapojení do projektů ELIXIR, ale i ostatní uživatelé MetaCentra využívající pražské úložné kapacity.

Co je nového?

-

Domovské adresáře (home): Pro uživatele ELIXIRu jsme navýšili prostor trojnásobně. Standardní kvóta je nyní nastavena na 5 TB (v odůvodněných případech je možné žádat o další navýšení). Ostatní uživatelé mají k dispozici 100 GB.

-

Projektové adresáře: Kapacita vyhrazená pro ELIXIR projekty se zdvojnásobila.

-

Flexibilita do budoucna: Část nového prostoru zatím zůstává záměrně nepřidělena. To nám umožní v budoucnu pružně reagovat na vaše potřeby a „přifouknout“ konkrétní adresáře tam, kde bude aktuálně největší hlad po datech.

Pole je standardně dostupné na všech výpočetních uzlech MetaCentra pod obvyklou cestou:/storage/praha5-elixir/

Věříme, že tento nový hardware přispěje k efektivní realizaci vašich výpočtů a vědeckých projektů.

Ivana Křenková, Thu May 07 21:40:00 CEST 2026

Upgrade diskového pole v Českých Budějovicích

S radostí oznamujeme dokončení významného upgradu diskového pole v lokalitě České Budějovice.

Tato modernizace přináší nejen řádové navýšení dostupné kapacity, ale také vyšší propustnost díky obměně řídicího hardwaru.

Co se změnilo?

- Navýšení kapacity: Celkový objem úložiště jsme z původních 150 TB rozšířili na 1 PB (petabajt).

- Modernizace frontendu: Došlo k výměně za výrazně výkonnější hardware, což zajistí rychlejší odezvu a vyšší stabilitu při intenzivních operacích s daty.

- Navýšení uživatelských kvót: V souvislosti s rozšířením pole jsme pro každého uživatele MetaCentra navýšili základní diskovou kvótu (soft quota) na tomto poli z původních 100 GB na 3 TB.

Technické parametry:

| Parametr | Původní stav | Nový stav |

|---|---|---|

| Celková kapacita pole | 150 TB | 1 PB |

| Uživatelská disková kvóta | 100 GB | 3 TB |

| Kvóta na počet souborů | 1M | 1M (beze změny) |

| Frontend Hardware | Standardní | Vysokovýkonný HW |

| Přístupová cesta | /storage/budejovice1 | |

Jak úložiště využít?

Pole je standardně dostupné na všech výpočetních uzlech MetaCentra pod obvyklou cestou: /storage/budejovice1

Věříme, že tento nový hardware přispěje k efektivní realizaci vašich výpočtů a vědeckých projektů.

Ivana Křenková, Tue Apr 28 21:40:00 CEST 2026

Nové clustery v MetaCentru: Rozšíření infrastruktury o zdroje CESNETu a CERIT-SC

S potěšením oznamujeme, že do infrastruktury MetaCentra byly úspěšně integrovány nové výpočetní clustery ve vlastnictví sdružení CESNET a Západočeské univerzity v Plzni (ZČU). Toto rozšíření přináší navýšení kapacity pro CPU i GPU výpočty a specializovaný SMP uzel s velkou sdílenou pamětí.

Níže uvádíme technické specifikace:

1. Cluster hildor (CESNET)

Vlastník: CESNET (hildor[1-20].metacentrum.cz, deimos[1-13].meta.zcu.cz, haldan[1-15].metacentrum.cz), České Budějovice, Plzeň, Brno

Celková kapacita: 48 uzlů / 6 144 CPU jader

Konfigurace uzlu:

- CPU: 2x AMD EPYC 9555 (64 jader na uzel)

- RAM: 768 GiB

- Úložiště: 2x 1,92 TB NVMe

- Síť: 10 nebo 25 Gbit/s + Infiniband HDR200

- Výkon: SPECrate 2017_fp_base 1700

Clustery jsou určeny pro výpočetně náročné úlohy využívající CPU, přičemž neobsahují GPU akceleraci.

2. Cluster grogu (CERIT-SC)

Vlastník: CERIT-SC (grogu[1-3].cerit-sc.cz, grogu[4-8].cerit-sc.cz), Brno

Celková kapacita: 8 uzlů / 768 CPU jader / 12 GPU

Konfigurace uzlu:

- CPU: 2x AMD EPYC 9454 48-Core Processor (96 jader na uzel)

- GPU: 4x NVIDIA RTX PRO 6000 Blackwell Server Edition (

grogu[1-3]) - RAM: 1536 GiB

- Úložiště: 6x 7 TB NVMe

- Síť: 100 Gbit/s

- Výkon: SPECrate 2017_fp_base 445

Clustery jsou určeny pro výpočetně náročné úlohy využívající CPU, přičemž uzly grogu[1-3]obsahují 4x GPU akceleraci.

Kompletní seznam dostupných výpočetních serverů a jejich aktuální vytížení naleznete na stránce: Hardware MetaCentra.

Věříme, že tento nový hardware přispěje k efektivní realizaci vašich výpočtů a vědeckých projektů.

Ivana Křenková, Tue Mar 31 21:40:00 CEST 2026

Upgrade frontendu skirit a představení verze „lite”

Vážení uživatelé,

v rámci neustálého vylepšování infrastruktury MetaCentra jsme provedli zásadní upgrade oblíbeného frontendu skirit. Abychom vám zajistili stabilnější a výkonnější prostředí pro vaši práci, přecházíme na nový hardware a zároveň zavádíme specializovanou odlehčenou verzi tohoto oblíbeného frontendu.

Nový frontend skirit: Plný výkon na novém HW

Hlavní frontend skirit.metacentrum.cz (alias skirit.grid.cesnet.cz) již běží na novém, výkonnějším hardwaru. Toto je primární adresa, kterou doporučujeme používat pro všechna nová spojení.

Novinka: Frontend skirit-lite pro nenáročné úkoly

Původní hardware frontendu skirit nekončí, ale mění svou roli. Pod novým názvem skirit-lite.metacentrum.cz bude sloužit jako „lehký” frontend.

- Kdy použít Skirit-Lite? Je ideální pro rychlou správu úloh, editaci skriptů nebo kontrolu stavu výpočtů.

- Kdy použít standardní Skirit? Pro náročnější interaktivní práci a operace vyžadující vyšší výpočetní výkon samotného frontendu.

Důležité informace k migraci

Pokud aktuálně využíváte původní server pod adresou skirit.ics.muni.cz, věnujte prosím pozornost následujícím bodům:

- Nepřihlašujte se na starou adresu: Na původním stroji (skirit.ics.muni.cz) bude v nejbližší době nastaven režim nologin. Nová sezení směřujte výhradně na skirit.metacentrum.cz.

- Dokončete rozdělanou práci: Stávající běžící spojení na starém hardwaru necháme doběhnout, ale po jejich ukončení již nebude možné se na tuto konkrétní instanci pod starým jménem přihlásit.

- Plánovaný restart: V horizontu nejbližších dní proběhne reboot starého stroje spojený s upgrade SW a definitivním přejmenováním na skirit-lite.ics.muni.cz.

- Změna SSH klíčů: V souvislosti s přejmenováním a výměnou HW vás může váš SSH klient upozornit na změnu otisků (host keys). To je v tomto případě očekávané chování.

- V práci s frontendy se pro uživatele jinak nic nezmění, home adresáře zůstavají zachovány beze změny.

Ivana Křenková, Tue Mar 24 21:40:00 CET 2026

Zapínáme šifrování interaktivních úloh

Vážení uživatelé,

v průběhu tohoto týdne nasadíme do provozu šifrování interaktivních úloh. Tento krok je důležitý pro zvýšení bezpečnosti přenosu dat a komunikace v rámci výpočetního prostředí MetaCentra.

Pro vás, jako uživatele, přináší tato aktualizace dvě praktické změny, na které bychom vás rádi upozornili:

1. Kontrola Kerberos lístku při přihlášení

Systém bude nově striktněji vyžadovat platný Kerberos lístek.

-

Pokud v okamžiku startu interaktivní úlohy nemáte platný Kerberos lístek (ticket), systém vás při pokusu o připojení k úloze vyzve k jeho obnově (zadání hesla /

kinit). -

Pokud lístek máte platný, přihlášení proběhne standardně bez další interakce.

2. Časový limit pro připojení (Timeout)

Zavádíme bezpečnostní časový limit pro zahájení práce.

-

Jakmile interaktivní úloha na klastru odstartuje (je jí přidělen výpočetní uzel), máte 3 hodiny na to, abyste se k ní připojili.

-

Pokud se k běžící úloze do 3 hodin nepřipojíte, bude automaticky zrušena.

Tato opatření nám pomáhají udržovat infrastrukturu bezpečnou a efektivně využívanou. Děkujeme za pochopení.

MetaCentrum

Ivana Křenková, Mon Feb 09 21:40:00 CET 2026

Váš názor nás zajímá: Ohodnoťte služby e-INFRA CZ

Počítáte u nás? Chceme znát váš názor.

Aby naše výpočetní a cloudové služby i nadále vyhovovaly nárokům vašeho výzkumu, potřebujeme znát váš názor. Vaše zpětná vazba je klíčová pro náš další strategický rozvoj. Pomáhá nám přesně určit, které oblasti infrastruktury – od plánování úloh (job scheduling) až po dostupnost úložišť – je třeba zlepšit nebo rozšířit.

Pokud jste již dotazník vyplnili dříve, děkujeme za Váš názor.

- Soukromí a odměna: Dotazník je standardně anonymní. Pokud se však rozhodnete uvést svůj login, jako poděkování za váš čas připíšeme na váš účet v MetaCentru ekvivalent 0,5 publikace.

-

Termín: Své odpovědi prosím odešlete do 14. února 2026.

-

Odkaz: Dotazník

Ivana Křenková, Tue Jan 20 21:40:00 CET 2026

Nové clustery v MetaCentru: Rozšíření infrastruktury o zdroje CESNETu a ZČU

S potěšením oznamujeme, že do infrastruktury MetaCentra byly úspěšně integrovány nové výpočetní clustery ve vlastnictví sdružení CESNET a Západočeské univerzity v Plzni (ZČU). Toto rozšíření přináší navýšení kapacity pro CPU i GPU výpočty a specializovaný SMP uzel s velkou sdílenou pamětí.

Níže uvádíme technické specifikace:

1. Cluster adan (CESNET)

Tento cluster nahrazuje původní cluster stejného jména. Je určen pro náročné výpočty na CPU a neobsahuje grafické akcelerátory. Cluster je již dostupný v běžných frontách plánovače.

-

Vlastník: CESNET

-

adan[1-48].grid.cesnet.cz -

Celková kapacita: 48 uzlů / 6 144 jader CPU

-

Konfigurace uzlu:

-

CPU: 2x AMD EPYC 9554 64-Core Processor

-

RAM: 768 GiB

-

Disk: 2x 3.84 TB NVMe

-

Síť: 25 Gbit/s

-

Výkon uzlu: SPECrate 2017_fp_base: 1360 (10.6 na jádro)

-

2. Cluster alfrid (ZČU)

Cluster alfrid[1-9].meta.zcu.cz prošel ve dvou fázích (květen a prosinec 2025) zásadní modernizací a rozšířením. Nahrazuje původní hardware a nabízí nyní 8 GPU uzlů a jeden SMP uzel. Cluster je již dostupný v prioritních frontách vlastníka (iti a zcu) a pro ostatní uživateleběžných krátkých frontách .

1. GPU uzly (alfrid alfrid[1-4].meta.zcu.cz a alfrid-II alfrid[6-9].meta.zcu.cz) Tyto uzly jsou vybaveny akcelerátory NVIDIA L40 a L40S, vhodné pro akcelerované výpočty a AI úlohy.

-

Vlastník: ZČU Plzeň

-

Celková kapacita: 8 uzlů / 1 024 jader CPU

-

Konfigurace uzlů:

-

CPU: 2x AMD EPYC 9554 64-Core Processor

-

RAM: 1 536 GiB (alfrid) / 768 GiB (alfrid-II)

-

GPU: 2x NVIDIA L40 48GB (alfrid) / 4x NVIDIA L40S 48GB (alfrid-II)

-

Disk: 2x 7 TB NVMe

-

Síť: 25 Gbit/s

-

Výkonuzlu : SPECrate 2017_fp_base: 1230

-

2. SMP uzel (alfrid-smp alfrid5.meta.zcu.cz) Specializovaný uzel určený pro úlohy vyžadující velké množství sdílené paměti.

-

Vlastník: ZČU Plzeň

-

Kapacita: 1 uzel / 128 jader CPU

-

Konfigurace uzlu:

-

CPU: 2x AMD EPYC 9554 64-Core Processor

-

AM: 4 608 GiB (přibližně 4,5 TB)

-

Disk: 2x 7 TB NVMe

-

Síť: 10 Gbit/s

-

Výkon uzlu: SPECrate 2017_fp_base: 1200

-

Kompletní seznam dostupných výpočetních serverů a jejich aktuální vytížení naleznete na stránce: Hardware MetaCentra.

Věříme, že tento nový hardware přispěje k efektivní realizaci vašich výpočtů a vědeckých projektů.

Ivana Křenková, Fri Jan 09 21:40:00 CET 2026

Vyhlášení 36. grantové soutěže v IT4I

|

||||||

|

||||||

|

Ivana Křenková, Mon Oct 20 21:40:00 CEST 2025

Ohlasy z uživatelského semináře MetaCentrum 2025

Ve čtvrtek 2. října 2025 proběhl v pražském Klubu Lávka Seminář výkonného počítání MetaCentrum 2025, kterého se zúčastnilo více než 90 účastníků na místě a dalších 60 účastníků se připojilo online.

Program byl zaměřen na zpracování a ukládání dat, bezpečnost, práci s kontejnery i cloudem a využití AI modelů na infrastruktuře MetaCentra a CERIT-SC. O své zkušenosti se podělili nejen odborníci z CESNET a CERIT-SC, ale i uživatelé z výzkumných skupin Masarykovy univerzity a Univerzity Karlovy.

Prezentace ze semináře jsou k dispozici na stránce akce. Na stejném odkaze bude, po sestříhání, vystaven i videozáznam ze semináře.

Ivana Křenková, Fri Oct 03 21:40:00 CEST 2025

Basics of Quantum Machine Learning

Vážení uživatelé,

Dovolujeme si Vás pozvat na akci pořádanou IT4Innovations: Basics of Quantum Machine Learning

https://events.it4i.cz/event/354/

|

||||||

|

Ivana Křenková, Tue Sep 09 21:40:00 CEST 2025

Pozvánka na uživatelský seminář MetaCentra

Vážení uživatelé,

Dovolujeme si Vás pozvat na pravidelný Seminář výkonného počítání MetaCentrum 2025, který se uskuteční ve čtvrtek 2. října 2025 v Novotného lávce v Praze s exkluzivním výhledem na Karlův most a centrum Prahy.

Seminář bude zaměřen na zpracování, analýzu a ukládání dat a také na představení novinek v gridovém, cloudovém a kubernetím prostředí MetaCentra a CERIT-SC.

Akci pořádá projekt MetaCentrum sdružení CESNET ve spolupráci s Centrem CERIT-SC při Ústavu výpočetní techniky Masarykovy univerzity.

Program a další informace:

https://metavo.metacentrum.cz/cs/seminars/Seminar2025/index.html

Na shledanou se těší Vaše MetaCentrum

Ivana Křenková, Thu Aug 21 21:40:00 CEST 2025

Nový GPU cluster v MetaCentru

S potěšením oznamujeme, že do infrastruktury MetaCentra byl úspěšně integrován nový výpočetní cluster fobos.meta.zcu.cz.

Parametry clusteru

- Počet uzlů: 20

- Celkový počet jader: 1920

- Konfigurace každého uzlu:

- CPU: 2x AMD EPYC 9454 2.75GHz 48-core 290W Processor

- RAM: 768 GiB

- GPU: 4x NVIDIA L40S 48GB

- Disk: 4x 3,84 NVMe

- Síť: Ethernet 100Gbit/s, InfiniBand 200Gbit/s

- Výkon (SPECrate 2017_fp_base): 1160

- Vlastník: CESNET

Přístup k výpočetním prostředkům

Cluster je dostupný v běžných frontách.

Kompletní seznam dostupných výpočetních serverů naleznete zde: https://metavo.metacentrum.cz/pbsmon2/hardware

Věříme, že tento nový hardware přispěje k efektivnější realizaci vašich výpočtů a vědeckých projektů!

Ivana Křenková, Tue Aug 19 23:50:00 CEST 2025

BeeGFS: rychlý sdíleny scratch v MetaCentru

Jsme rádi, že Vám můžeme oznámit dostupnost nového rychlého sdíleného scratchu s využitím paralelního distribuovaného souborového systému BeeGFS na našem clusteru bee.cerit-sc.cz. Tento nový zdroj, dostupný jako scratch_shared, je speciálně navržen pro potřeby vysokovýkonných výpočtů (HPC) a nabízí řadu výhod pro aplikace náročné na data a výpočty.

Proč použít BeeGFS v MetaCentru?

BeeGFS je ideální volbou pro náročné úlohy, které vyžadují:

- Práci s velkými soubory nebo obrovským počtem malých souborů – efektivně zpracovává masivní datové soubory, což je ideální pro aplikace vyžadující rychlé a škálovatelné úložiště.

- Využití mnoha vláken nebo procesů čtoucích nebo zapisujících paralelně – umožňuje vysokovýkonný a souběžný přístup k datům, což je perfektní pro aplikace vyžadující simultánní čtení a zápis.

- Zpracování napříč více výpočetními uzly – zvládne pracovní zátěže, které sahají přes více výpočetních uzlů, což umožňuje bezproblémovou škálovatelnost a výkon.

- Sekvenční výpočty s mezivýsledky – dobře vhodné pro pracovní postupy, kde následné výpočty mohou využít mezivýsledky uložené ve scratch adresáři, čímž odpadá potřeba kopírovat data do trvalého úložiště nebo spouštět úlohu na stejném počítači jako předchozí krok.

Typické případy použití:

- Vysokovýkonové výpočty (HPC) – BeeGFS je navržen tak, aby efektivně zvládal velké soubory a paralelní vstupní/výstupní operace, což je ideální pro vědecké výpočty.

- Strojové učení a umělá inteligence – s BeeGFS můžete trénovat modely strojového učení rychleji díky přístupu k velkým objemům dat s vysokou propustností a nízkou latencí.

- Simulace, vykreslování, genomika a výzkum velkých dat – BeeGFS je perfektní pro zpracování masivních datových souborů, jako jsou ty, které se vyskytují při 3D vykreslování, složitých simulacích, genomické sekvenování a výzkumu velkých dat.

Více informací:

- Článek na blogu: https://blog.e-infra.cz/blog/beegfs/

- Dokumentace: https://docs.metacentrum.cz/en/docs/computing/infrastructure/scratch-storages#shared-scratch-on-cluster-beecerit-sccz

Ivana Křenková, Fri Aug 08 23:50:00 CEST 2025

Nový výpočetní cluster projektu ELIXIR v MetaCentru

S potěšením oznamujeme, že do infrastruktury MetaCentra byly úspěšně integrované nové výpočetní clustery elbi1.hw.elixir-czech.cz, elmu1.hw.elixir-czech.cz, eluo1.hw.elixir-czech.cz, elum1.hw.elixir-czech.cz projektu ELIXIR. Clustery mají velmi podobnou konfiguraci a jsou umístěné v různých lokalitách.

Parametry clusterů

|

elmu1.hw.elixir-czech.cz (2400 CPU, 25 uzlů ) - Cluster výpočetních strojů (MUNI Brno)

|

eluo1.hw.elixir-czech.cz (576 CPU, 6 uzlů ) - Cluster výpočetních strojů (UOCHB Praha)

|

elum1.hw.elixir-czech.cz (96 CPU, 1 uzel ) - Cluster výpočetních strojů (UMG Praha)

|

Přístup k výpočetním prostředkům

Cluster je dostupný v prioritních frontách Elixíru. Cluster elbi1 má k dispozici 2 GPU karty a je přístupný i v gpu frontách. Ostatní uživatelé mohou cluster využívat v krátkých běžných frontách s limitem do 24 hodin.

Kompletní seznam dostupných výpočetních serverů naleznete zde: https://metavo.metacentrum.cz/pbsmon2/hardware

Věříme, že tento nový hardware přispěje k efektivnější realizaci vašich výpočtů a vědeckých projektů!

Ivana Křenková, Thu Mar 27 23:50:00 CET 2025

Integrace AI chatu do dokumentace, WebUI s AI chatem a nový blog

Vážení uživatelé,

s potěšením vám oznamujeme, že pro vás máme tři novinky:

- Dokumentaci v novém designu s integrovaným AI chatem -- nasadíme brzy

- WebUI s integrovaným AI chatem

- Nový blog

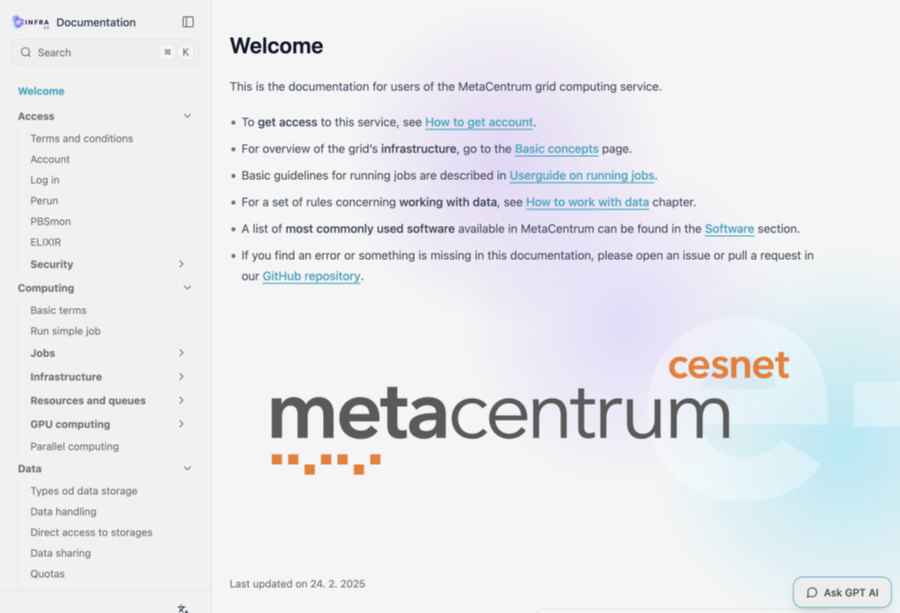

Dokumentace v novém designu s integrovaným AI chatem

Nasadíme brzy! Naše stávající dokumentace https://docs.metacentrum.cz/ prošla vizuální modernizací.

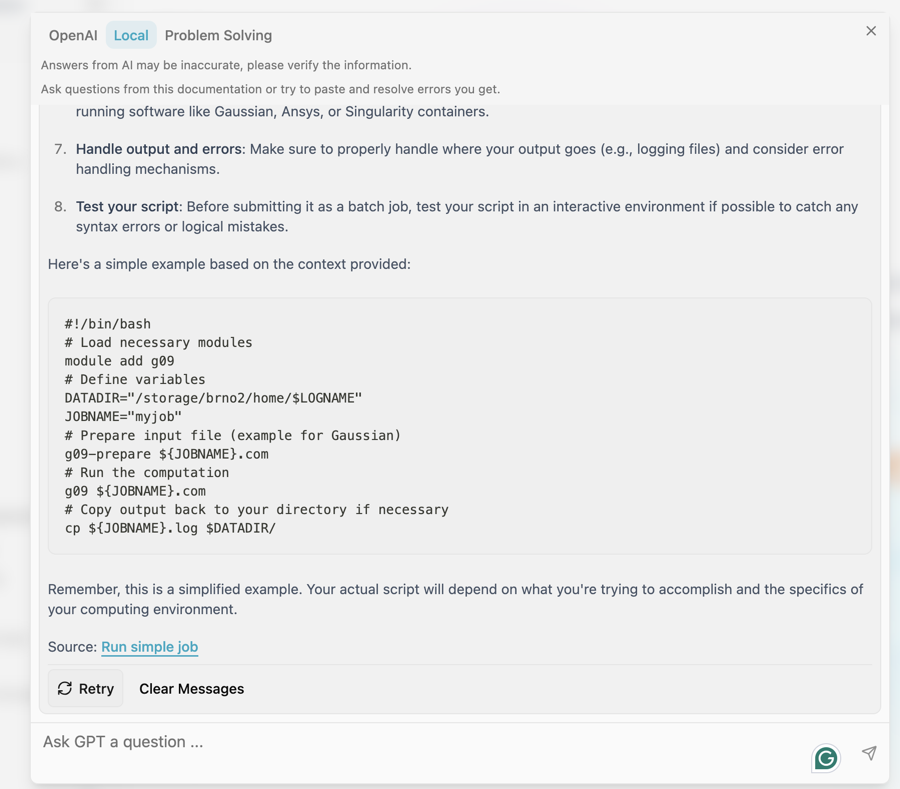

I když její struktura zůstává beze změny, převedli jsme ji na novou technologii podporující integraci AI chatu (https://docs.metacentrum.cz/en/docs/tutorials/chat-help) , který vám pomůže rychle najít odpovědi na otázky týkající se dokumentace.

AI chat umístěný v pravém dolním rohu umožňuje, po přihlášení, interaktivní vyhledávání informací obsažených v dokumentaci. Volte volbu Local, pokud chcete odpověď založenou na obsahu dokumentace. Volba Problem Solving řeší nejčastější problémy, na které můžete narazit.

Budeme rádi za vaši zpětnou vazbu. Na základě vašich dotazů a připomínek budeme průběžně dokumentaci vylepšovat.

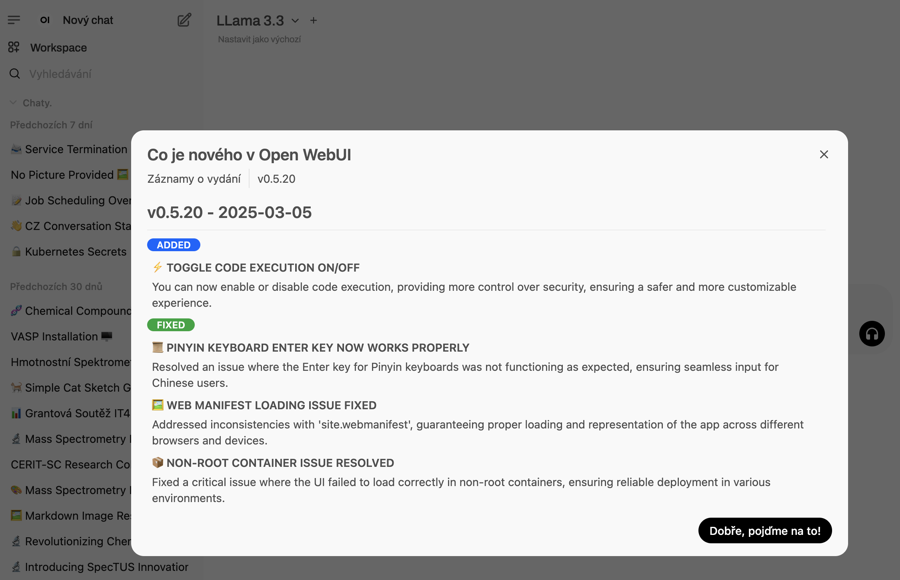

WebUI s integrovaným AI chatem

Zároveň jsme zprovoznili samostatný AI chat dostupný na https://chat.ai.e-infra.cz/. Je v něm dostupných několik modelů k vyzkoušení, podporuje kreslení obrázků i čtení přiložených dokumentů. Modely běží u nás lokálně na našich výpočetních zdrojích, takže se nemusíte bát úniku dat mimo naši infrastrukturu.

Všechny nabízené modely jsou k dispozici také přes API a je je možné využít pro Vaše projekty. Dokumentace je k dispozici na:

https://docs.cerit.io/en/docs/web-apps/chat-ai

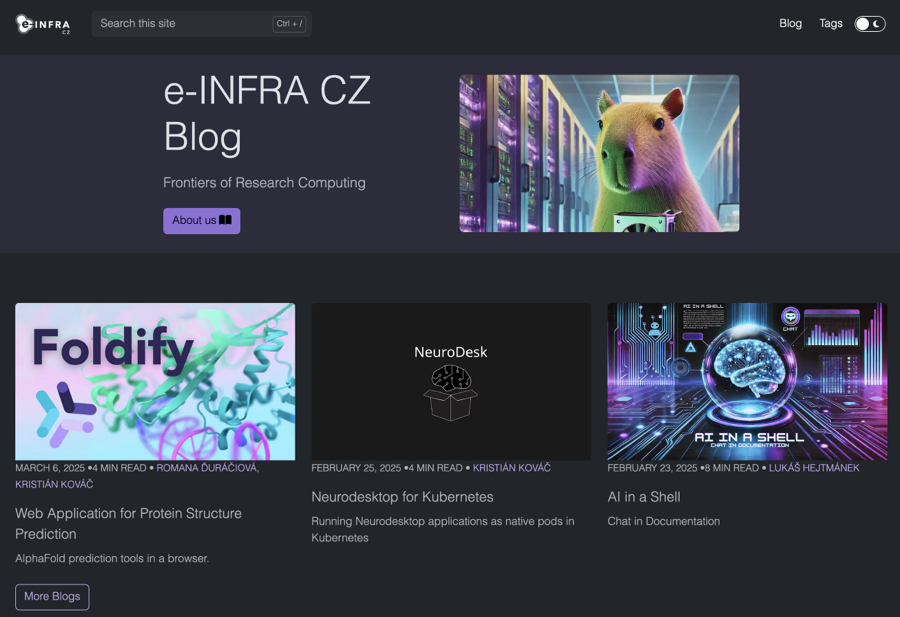

Nový blog

Zajímavosti k AI chatu i k jiným tématům, které se týkají infrastruktury, najdete v našem blogu https://blog.e-infra.cz/

Ivana Křenková, Mon Mar 10 21:40:00 CET 2025

Další kolo grantové soutěže v IT4Innovations

Vážení uživatelé,

|

|||||||||||||||||||

|

Ivana Křenková, Mon Feb 24 21:40:00 CET 2025

Změna přístupu ke stroji NVIDIA DGX H100 (capy.cerit-sc.cz)

Upozorňujeme uživatele, že došlo ke změně způsobu přístupu k výpočetnímu stroji NVIDIA DGX H100 80GB (capy.cerit-sc.cz).

Nově bude přístup umožněn pouze na základě schválené žádosti o výpočetní čas. Kritéria a postup podání žádosti naleznete zde: docs.metacentrum.cz/computing/gpu-comput/dgx/.

Pokud vaše výpočetní požadavky nesplňují stanovená kritéria, ale potřebujete GPU s velkou pamětí, můžete využít GPU cluster bee (bee.cerit-sc.cz) s NVIDIA 2×H100 94GB. Více informací o tomto clusteru najdete v předchozí novince: Odkaz na novinku.

Vaše MetaCentrum

Ivana Křenková, Mon Feb 17 23:50:00 CET 2025

Nový výpočetní cluster v MetaCentru

S potěšením oznamujeme, že do infrastruktury MetaCentra byl úspěšně integrován nový výpočetní cluster farin.grid.cesnet.cz provozovaný Fakultou stavební ČVUT v Praze.

Parametry clusteru

- Počet uzlů: 4

- Celkový počet jader: 512

- Konfigurace každého uzlu:

- CPU: 2x AMD EPYC 9554 64-Core Processor

- RAM: 2304 GiB

- Disk: 14 TB NVMe

- Síť: Ethernet 25 Gbit/s

- Výkon (SPECrate 2017_fp_base): 1300

- Vlastník: Fakulta stavební ČVUT v Praze

Přístup k výpočetním prostředkům

Cluster je dostupný v prioritní frontě vlastníka cvut@pbs-m1.metacentrum.cz. Ostatní uživatelé mohou cluster využívat v krátkých běžných frontách s limitem do 24 hodin.

Studenti a zaměstnanci Fakulty stavební ČVUT mají možnost požádat o přístup do vyhrazené fronty.

Kompletní seznam dostupných výpočetních serverů naleznete zde: https://metavo.metacentrum.cz/pbsmon2/hardware

Věříme, že tento nový hardware přispěje k efektivnější realizaci vašich výpočtů a vědeckých projektů!

Ivana Křenková, Tue Feb 04 23:50:00 CET 2025

Migrace osobních projektů v MetaCentrum OpenStack Cloudu

Migrace projektů běžících v e-INFRA CZ / Metacentrum OpenStack cloudu Brno G1 [1] do nového prostředí Brno G2 [2], která probíhala v průběhu roku 2024, se blíží do finální fáze.

Migrace osobních projektů [3] bude umožněna od února 2025 a bude možné ji učinit svépomocí.

Postup migrace bude aktualizován v průběhu ledna 2025 na stránkách [2], [4].

Detailněji o postupu a novinkách Vás budeme průběžně informovat na úvodní stránce G2 e-INFRA CZ / Metacentrum OpenStack cloudu [2].

Děkujeme za pochopení.

e-INFRA CZ / Metacentrum OpenStack cloud tým

cloud@metacentrum.cz

[1] https://cloud.metacentrum.cz/

[2] https://brno.openstack.cloud.e-infra.cz/

[3] https://docs.e-infra.cz/compute/openstack/technical-reference/brno-g1-site/get-access/#personal-project

[4] https://docs.e-infra.cz/compute/openstack/migration-to-g2-openstack-cloud/#may-i-perform-my-workload-migration-on-my-own

Ivana Křenková, Fri Dec 27 23:50:00 CET 2024

Nový SW

Vážené uživatelky a uživatelé MetaCentra,

doufáme, že Vás potěší několik novinek, které jsme připravili pro zvýšení vašich možností při výpočtech a optimalizaci vašich projektů. Snažíme se nabídnout špičkové softwarové nástroje a inovativní služby, které zefektivní práci a umožní kvalitnější výsledky.

Nové licence pro software MolPro a Turbomole

MetaCentrum nyní disponuje novými komerčními licencemi pro kvantově chemické výpočty pomocí nástrojů MolPro a Turbomole. Tyto nástroje umožní detailnější a efektivnější simulace i analýzy molekulárních systémů:

- MolPro: Vysoce výkonný nástroj zaměřený na elektronové struktury, ideální pro pokročilé teorie jako metoda Hartree-Fock a teorie korelace. Pomáhá zvládnout složité kvantově chemické úkoly s vysokou přesností.

- Turbomole: Komplexní balík vhodný pro rozsáhlé molekulární systémy, známý rychlostí a efektivitou. Nabízí širokou škálu výpočtů včetně analýzy elektronové struktury a optimalizace geometrie molekul.

Podrobné informace o všech softwarových možnostech dostupných v MetaCentru naleznete zde: https://docs.metacentrum.cz/software/alphabet/

Nová webová služba Foldify

S radostí představujeme novou webovou službu Foldify, která je nyní plně integrovaná do prostředí Kubernetes. Foldify je špičková platforma navržená pro prostorové skládání proteinů, která vyniká svým snadným a uživatelsky přívětivým rozhraním. Tato služba výrazně zjednodušuje a zefektivňuje práci odborníků v oblasti biochemie a biofyziky. Uživatelům nabízí široké možnosti zpracování dat, neboť kromě populárního AlphaFoldu podporuje také nástroje jako ColabFold, OmegaFold a ESMFOLD.

Foldify můžete prozkoumat a využít na této adrese: https://foldify.cloud.e-infra.cz/

Přejeme Vám pohodové Vánoce a vše nejlepší do Nového roku.

Vaše MetaCentrum

Ivana Křenková, Mon Dec 23 23:50:00 CET 2024

Nový HW v MetaCentru

MetaCentrum bylo nedávno rozšířeno o dva nové výkonné clustery:

1) Masarykova univerzita (CERIT-SC) přikoupila k výkonnému stroji NVIDIA DGX H100 další cluster čítající 32x NVIDIA H100 GPU (94 GB GPU RAM) ve 20 uzlech s 960 CPU jádry vhodných pro AI náročné výpočty.

- 10 uzlů je zpřístupněno dávkovým způsobem v MetaCentru - cluster bee.cerit-sc.cz,

- 8 uzlů je k dispozici v Kubernetes / Rancheru,

- 2 uzly jsou v Sensitive Cloudu pro práci s citlivými daty.

2) Fyzikální ústav Akademie věd zapojil do MetaCentra nový cluster magma.fzu.cz sestávající z 23 uzlů celkem s 2208 CPU jádry a každý s 1,5 TB RAM

Konfigurace a režim přístupu

1) Cluster bee.cerit-sc.cz

V dávkovém systému MetaCentra je zapojených 10 uzlů, celkem s 960 CPU jádry a 20x NVIDIA H100 s následující konfigurací každého uzlu:

| CPU | 2x AMD EPYC 9454 48-Core Processor |

|---|---|

| RAM | 1536 GiB |

| GPU | 2x H100 s 94 GB GPU RAM |

| disk | 8x 7TB SSD s podporou BeeGFS |

| net | Ethernet 100Gbit/s, InfiniBand 200Gbit/s |

| poznámka | Výkon každého uzlu je dle SPECrate 2017_fp_base = 1060 |

| vlastník | CERIT-SC |

Cluster podporuje nástroje NVidia GPU Cloud (NGC) pro hluboké učení, včetně předkonfigurovaných prostředí a je přístupný v běžných gpu frontách.

Zároveň připravujeme změnu pro přístup ke stroji NVIDIA DGX H100, který zůstane ve speciální frontě gpu_dgx@meta-pbs.metacentrum.cz. Bude využitelný na požádání a jen uživateli, kteří prokáží, že jejich úlohy podporují NVLink a umí využít alespoň 4 nebo všech 8 GPU kartet zaráz. O připravované změně budeme ještě informovat.

2) Cluster magma.fzu.cz

V dávkovém systému MetaCentra je zapojených 23 uzlů, celkem s 2208 CPU jader s následující konfigurací každého uzlu:

| CPU | 2x AMD EPYC 9454 48-Core Processor CPU @ 2.7GHz |

|---|---|

| RAM | 1536 GiBidia |

| isk | 1x 3.84 NVMe |

| net | Ethernet 10Gbit/s |

| poznámka | Výkon každého uzlu je dle SPECrate 2017_fp_base = 1160 |

| vlastník | FZÚ AV ČR |

Cluster je přístupný v prioritní frontě vlastníka luna@pbs-m1.metacentrum.cz a pro ostatní uživatele v krátkých běžných frontách.

Kompletní seznam aktuálně dostupných výpočetních serverů je na http://metavo.metacentrum.cz/pbsmon2/hardware.

S přáním příjemného počítání,

Ivana Křenková, Mon Nov 18 23:40:00 CET 2024

Další kolo grantové soutěže v IT4Innovations Natinal Supercomputeing Center

Vážení uživatelé,

dovolujeme si přeposlat informaci o grantové soutěži v IT4I:

|

||||||||

|

Ivana Křenková, Fri Oct 18 21:40:00 CEST 2024

Přechod na novou OpenPBS a Debian12

Vážení uživatelé,

Na začátku března jsme poprvé informovali o zahájení přechodu na novou PBSPro —> OpenPBS.

- Všechny dostupné výpočetní kapacity budou dostupné pod jediným PBS serverem pbs-m1.metacentrum.cz. Pokračujeme s reinstalací a přesunem clusterů vlastníků CERIT-SC (cerit-pbs) a ELIXIR CZ (elixir-pbs) pod tento PBS server.

- Stávající PBSPro servery budou, po doběhnutí zbylých úloh, odstaveny z provozu. Prosíme, přesuňte si své úlohy již do nového prostředí, ulehčíte nám migraci a rychleji se nám podaří přesun dokončit.

- Zároveň s migrací na novou PBS probíhá upgrade OS: Debian11 —> Debian12.

Pokud se tak již nestalo, používejte pro své úlohy nové OpenPBS prostředí pbs-m1.metacentrum.cz. Pokud nechcete ve svých skriptech nic měnit, zadávejte úlohy z frontendů s OS Debian12, názvy front zůstanou zachované, změní se jen PBS server (FRONTA@pbs-m1.metacentrum.cz).

Seznam dostupných frontendů včetně aktuálního OS najdete na stránce https://docs.metacentrum.cz/computing/frontends/

Nyní je v novém OpenPBS prostředí k dispozici cca 3/4 clusterů, na reinstalaci dalších intenzivně pracujeme. Čekáme na doběhnutí úloh.

Přehled strojů s vlastností Debian12: https://metavo.metacentrum.cz/pbsmon2/props?property=os%3Ddebian12

Zda se Vaše úloha spustí v novém OpenPBS prostředí, můžete vyzkoušet v Sestavovači qsub: https://metavo.metacentrum.cz/pbsmon2/qsub_pbspro

Aktuální informace o migraci najdete v dokumentaci https://docs.metacentrum.cz/tutorials/debian-12/ (postup migrace zde aktualizujeme).

Vaše MetaCentrum

Ivana Křenková, Tue May 14 15:35:00 CEST 2024

Úpravy v prostředí Open OnDemand

Vážení uživatelé,

Provedli jsme změnu ve službě Open OnDemand (OOD), kdy se nově OOD úlohy spouštějí také na clusterech, které nemají výchozí home na poli brno2. Z toho důvodu se může stát, že již existující data, historie příkazu, atd. z pole brno2 nebudou dostupná v nové OOD úloze, pokud bude spuštěna na stroji s jiným /home.

Pro přístup k původním datům na poli brno2 bude nutné nastavit symbolický odkaz na pole nové. Příklad níže nastavuje symbolický odkaz pro historii programu R.

ln -s /storage/brno2/home/user_name/.Rhistory /storage/new_location/home/user_name/.Rhistory

Vaše MetaCentrum

Ivana Křenková, Mon May 13 15:35:00 CEST 2024

Konference e-INFRA CZ

Na Konferenci e-INFRA CZ 2024, která se konala 29. - 30. dubna 2024 v Praze v hotelu Occindental, se sešlo přes 180 účastníků.

Prezentace z přednášek jsou k dispozici na stránkách akce.

Videozáznam připravujeme a zveřejníme brzy rovněž na stránkách akce.

Ivana Křenková, Thu May 02 15:35:00 CEST 2024

Přechod na novou OpenPBS a Debian12

Na začátku března jsme informovali o zahájení přechodu na novou PBSPro —> OpenPBS.

- Cca polovina výpočetního výkonu je nyní k dispozici v novém prostředí řízeném plánovačem pbs-m1.metacentrum.cz, zároveň stávající plánovač meta-pbs.metacentrum.cz přestane přijímat úlohy delší než 4 dny, abychom mohli přeinstalovat a přesunout i zbylé výpočetní kapacity. PBS prostředí cerit-pbs a elixir-pbs běží zatím beze změny.

- Stávající PBSPro servery budou v budoucnu odstaveny z provozu, protože nemohou přímo komunikovat s novými OpenPBS servery a utilitami.

- Zároveň s migrací na novou PBS probíhá upgrade OS: Debian11 —> Debian12.

Pokud se tak již nestalo, používejte pro své úlohy nové OpenPBS prostředí pbs-m1.metacentrum.cz. Pokud nechcete ve svých skriptech nic měnit, zadávejte úlohy dočasně z nového frontendu zenith nebo z přeinstalovaných frontendů nympha, tilia a perian běžících v novém OpenPBS prostředí (už s OS Debian12). Ostatní frontendy budeme převádět postupně.

Seznam dostupných frontendů včetně aktuálního OS najdete na stránce https://docs.metacentrum.cz/computing/frontends/

Přístup k nové PBS je možný také z ostatních frontendů, je však nutná aktivace modulu openpbs (module add openpbs).

Problémy s kompatibilitou některých aplikací s OS Debian12 průběžně řešíme rekompilací nových SW modulů. Pokud narazíte na problém u své aplikace, vyzkoušejte přidání modulu debian11/compat na začátek spouštěcího skriptu (module add debian11/compat). Pokud problémy přetrvávají (chybějící knihovny atd.), dejte nám vědět na meta(at)cesnet.cz.

Nyní je v novém OpenPBS prostředí k dispozici cca polovina clusterů, na reinstalaci dalších intenzivně pracujeme. Čekáme na doběhnutí úloh. Přehled strojů s vlastností Debian12: https://metavo.metacentrum.cz/pbsmon2/props?property=os%3Ddebian12

Zda se Vaše úloha spustí v novém OpenPBS prostředí můžete vyzkoušet v Sestavovači qsub: https://metavo.metacentrum.cz/pbsmon2/qsub_pbspro

Aktuální informace o migraci najdete v dokumentaci https://docs.metacentrum.cz/tutorials/debian-12/ (postup migrace zde aktualizujeme).

Ivana Křenková, Mon Apr 08 15:35:00 CEST 2024

Pozvánka na Konferenci e-INFRA CZ 2024

Vážení uživatelé,

Dovolujeme si Vás tímto pozvat k účasti na Konferenci e-INFRA CZ 2024, která se koná 29. - 30. dubna 2024 v Praze v hotelu Occindental.

Na konferenci vám představíme infrastrukturu e-INFRA CZ, její služby, mezinárodní projekty a výzkumné aktivity. Seznámíme Vás s aktuálními novinkami a nastíníme také plány MetaCentra. Druhý den konference přinese konkrétní rady a příklady užití infrastruktury.

Konference bude vedena v anglickém jazyce.

Na shledanou se těší Vaše MetaCentrum

Ivana Křenková, Wed Mar 20 21:40:00 CET 2024

Pozvánka na Open day for the launch of the OSCARS Open Call for Open Science Projects

Vážení uživatelé,

přeposíláme pozvánku na

Open day for the launch of the OSCARS Open Call for Open Science Projects

15 March 2024

|

|

S přáním příjemného počítání,

Ivana Křenková, Wed Mar 13 23:40:00 CET 2024

Novinky infrastruktury MetaCentrum & CERIT-SC

Obsah

2) Dotazník ke službám MetaCentra / e-INFRA CZ

3) Změny v dostupnosti komerčních SW (Matlab, Mathematica)

4) Dostupná grafická prostředí (Galaxy, Chipster, OnDemand, Kubernetes/Rancher, JupyterNotebooks, Alphafold)

5) Stěhování dat z archivního úložiště na objektové úložiště

------------------------------------------------------------------

1) Přechod na novou PBS a Debian12 — testování kompatibility SW

Připravujeme přechod na novou PBS - OpenPBS. Stávající PBSPro servery budou v budoucnu odstaveny z provozu, protože nemohou přímo komunikovat s novými OpenPBS servery a utilitami. Zároveň s migrací na novou PBS probíhá upgrade OS: Debian11 —> Debian12.

Pro testovací účely jsme připravili nové OpenPBS prostředí pbs-m1.metacentrum.cz s novým frontendem zenith běžícím na OS Debian12:

• nový frontend zenith.cerit-sc.cz (alias zenith.metacentrum.cz) s OS Debian12

• nový OpenPBS server pbs-m1.metacentrum.cz

• home /storage/brno12-cerit/

Postupně bude nové prostředí doplňováno o další clustery.

Přehled strojů s Debian12: https://metavo.metacentrum.cz/pbsmon2/props?property=os%3Ddebian12

Seznam dostupných frontendů včetně aktuálního OS: https://docs.metacentrum.cz/computing/frontends/

Přístup k nové PBS je možný také z ostatních frontendů, je však nutná aktivace modulu openpbs (module add openpbs).

Problémy s kompatibilitou některých aplikací s OS Debian12 průběžně řešíme rekompilací nových SW modulů. Pokud narazíte na problém u své aplikace, vyzkoušejte přidání modulu debian11/compat na začátek spouštěcího skriptu (module add debian11/compat). Pokud problémy přetrvávají (chybějící knihovny atd.), dejte nám vědět na meta(at)cesnet.cz.

Více informací najdete v dokumentaci https://docs.metacentrum.cz/tutorials/debian-12/ (postup migrace zde budeme upřesňovat).

2) Dotazník ke službám MetaCentra / e-INFRA CZ

Chtěli bychom Vám připomenout možnost sdílet s námi své zkušenosti s výpočetními službami velké výzkumné infrastruktury e-INFRA CZ, kterou tvoří e-infrastruktury CESNET, CERIT-SC a IT4Innovations. Prosíme o vyplnění dotazníku do 8. 3. 2024. Vaše odpovědi nám pomohou upravit naše služby tak, aby Vám lépe vyhovovaly.

Pokud jste již dotazník vyplnili, děkujeme Vám za to! Velmi si toho vážíme.

Dotazník je dostupný na adrese https://survey.e-infra.cz/compute

3) Změny v dostupnosti komerčních SW (Matlab, Mathematica)

Matlab

Získali jsme novou akademickou licenci pro 200 instancí Matlab 9.14 a novějšího (včetně široké škály toolboxů), pokrývající výpočetní prostředí MetaCentra, CERIT-SC i IT4Innovations.

Tato nová licence má přísnější podmínky než předchozí: lze ji používat pouze z IP adres MetaCenta/IT4Innovations, tj. nelze ji použít pro Matlab spuštěný na vašem počítači/univerzitní přednáškové místnosti.

Více informací: https://docs.metacentrum.cz/software/sw-list/matlab/

Mathematica

Od letošního roku již MetaCentrum nevlastní gridovou licenci SW Mathematica pro obecné využití v MetaCentru (dodavatel nedokázal nabídnout vhodný licenční model).

V současné době jsou licence Mathematica 9 omezeny pouze na členy UK a JČU, které mají vlastní licence pro své studenty a zaměstnance. Pokud máte vlastní (institucionální) licenci SW Mathematica, kontaktujte nás pro více informací na adrese meta(at)cesnet.cz.

Více informací: https://docs.metacentrum.cz/software/sw-list/wolfram-math/

4) Dostupná grafická prostředí a workflow (Chipster, Galaxy, OnDemand, Kubernetes/Rancher, Jupyter Notebooky, Alphafold)

Chipster

MetaCentrum pro své uživatele nově zpřístupnila vlastní instanci nástroje Chipster, dostupného na adrese https://chipster.metacentrum.cz/.

Chipster je open-source nástroj pro analýzu genomických dat. Jeho hlavním cílem je umožnit výzkumníkům a bioinformatickým odborníkům provádět pokročilé analýzy nad genomickými daty, jako jsou sekvenční data, mikročipy a RNA-seq. Zde jsou některé klíčové rysy Chipsteru:

- uživatelsky přívětivé rozhraní, které umožňuje snadnou manipulaci s daty a provádění analýz

- lze přidávat a kombinovat různé moduly pro specifické úkoly

- mnoho předdefinovaných analýz (500), jako jsou diferenciální exprese genů, GO analýza, variant calling a další

- umožňuje práci s velkými datovými sadami a je optimalizován pro efektivní výpočty

- lze propojit s dalšími bioinformatickými nástroji a databázemi

Více informací: https://docs.metacentrum.cz/related/chipster/

Galaxy pro uživatele MetaCentra

Galaxy je otevřená webová platforma určená pro analýzu dat FAIR, původně v biomedicínském výzkumu, ale v současné době zahrnuje mnoho vědeckých oblastí. Pro uživatele MetaCentra jsme připravili dvě prostředí Galaxy pro obecné použití:

a) usegalaxy.cz

Obecný portál https://usegalaxy.cz/, který kopíruje funkčnost (zejména sadu dostupných nástrojů) celosvětových služeb (usegalaxy.org, usegalaxy.eu) a zároveň nabízí registrovaným uživatelům MetaCentra výrazně vyšší uživatelské kvóty (výpočetní i úložné). Zde jsou některé klíčové vlastnosti:

- flexibilní nástroj, který podporuje různé typy dat a analýz. Můžete ho použít pro bioinformatiku, chemii, fyziku, sociální vědy a další obory.

- umožňuje vytvářet a sdílet pracovní toky (workflows), které mohou obsahovat různé kroky (filtrace, transformace, analýza a vizualizace dat)

- umožňuje propojení s dalšími nástroji a knihovnami (Python, R nebo SQL) pro pokročilé analýzy

- nástroje pro vizualizaci dat (grafy, mapy a animace)

Více informací: https://docs.metacentrum.cz/related/galaxy/

b) RepeatExplorer Galaxy

Vedle obecně využitelné Galaxy nabízíme našim uživatelům specializovanou instanci Galaxy s nástrojem Repeat Explorer. Ke službě je potřeba se registrovat.

RepeatExplorer je výkonný nástroj pro zpracování dat, který je založen na platformě Galaxy. Jeho hlavním účelem je charakterizace opakujících se sekvencí v datech získaných ze sekvenování. Klíčové vlastnosti:

- umožňuje identifikovat a analyzovat repetitivní sekvence v genomu

- grafické shlukování umožňuje vizualizaci repetitivních sekvencí

- zahrnuje nástroje pro detekci proteinových kódových domén transponovatelných elementů.

Více informací: https://galaxy-elixir.cerit-sc.cz/

OnDemand

Open OnDemand https://ondemand.grid.cesnet.cz/ je služba, která uživatelům umožňuje přístup k výpočetním zdrojům přes webový prohlížeč v grafickém režimu. Uživatel může spouštět běžné úlohy PBS, získat přístup k frontend terminálům, kopírovat soubory mezi úložišti nebo spouštět několik grafických aplikací přímo v prohlížeči. Některé z funkcí:

- umožňuje prohlížení a správu souborů v domovském adresáři na úložišti /storage/brno2 a také přístup k dalším úložištím v MetaCentru

- zobrazuje seznam vašich běžících úloh na libovolném PBS serveru, lze vytvářet a spouštět nové úlohy

- poskytuje terminálový přístup k front-endům skirit/zuphux/elmo

- nabízí interaktivní grafické uživatelské rozhraní, včetně MetaCentrum Remote Desktop, ANSYS, MATLAB, Jupyter Notebooks, RStudio,..

Více nformací: https://docs.metacentrum.cz/software/ondemand/

Kubernetes/Rancher

Celá řada grafických aplikací je dostupná rovněž v Kubernetes / Rancher https://rancher.cloud.e-infra.cz/dashboard/ ve správě Centra CERIT-SC (Ansys, Remote Desktop, Matlab, RStudio, …)

Více informací: https://docs.cerit.io/

JupyterNotebooky

Jupyter Notebooks jsou prostředím „as a Service“ založeným na technologii Jupyter. Jedná se o nástroj, který je dostupný přes webový prohlížeč a umožňuje uživatelům kombinovat kód (zejména v jazyce Python), výstupy ve formátu Markdown, text, matematiku, výpočty a bohatý mediální obsah.

Uživatelé MetaCentra mohou využívat Jupyter Notebooks ve třech variantách:

a) v cloudu: Pro uživatele MetaCentra je dostupný Jupyter přes MetaCentrum Cloud Hub. Registrace není nutná, stačí se přihlásit pomocí svého Metacentrum účtu. Více informací: https://docs.metacentrum.cz/related/jupyter/

b) v Kubernetes: Jupyter lze také provozovat v Kubernetes clusteru. V tomto případě se přihlašuje také pomocí Metacentrum přihlašovacích údajů.

Více informací: https://docs.cerit.io/docs/jupyterhub.html

c) jako aplikace v OnDemand

https://ondemand.grid.cesnet.cz/

AlphaFold

AlphaFold je populární nástroj založený na umělé inteligenci, který slouží k predikci 3D struktury proteinů. Jeho revoluční přístup v oblasti biochemie a návrhu léčiv umožňuje přesněji předpovídat, jak se proteiny skládají do třídimenzionálních struktur. Opět jej nabízíme ve třech variantách:

a) Centrum CERIT-SC nabízí přístup k AlphaFold as a Service ve webovém prohlížeči (jako předpřipravený Jupyter Notebook)

Více informací: https://docs.cerit.io/docs/alphafold.html

b) v dávkových úlohách v OnDemand https://ondemand.grid.cesnet.cz/pun/sys/myjobs/workflows/new

c) v dávkových úlohách pomocí RemoteDesktop a předpřipravených kontejnerů pro Singularity

Více informací: https://docs.metacentrum.cz/software/sw-list/alphafold/

5) Stěhování dat z archivního úložiště v Ostravě (převzato od DU CESNET)

Archivní úložiště du4.cesnet.cz v MetaCentru připojené jako storage-du-cesnet.metacentrum.cz je již mimo záruku a vykazuje řadu technických problémů v mechanice páskové knihovny, což neohrožuje samotná uložená data, ale komplikuje jejich dostupnost. Kolegové z Datových úložišť CESNET připravují přesun stávajících dat na nový systém (Object Storage).

Nyní je potřeba co nejvíce utlumit provoz na tomto úložišti, prosíme proto

- omezte zápis i čtení z tohoto/na toto úložiště

- nepoužívejte data z tohoto úložiště přímo pro výpočty v MetaCentru

Pokud potřebujete zde uložená data k výpočtům, domluvte si prioritní přesun s kolegy na du-support(at)cesnet.cz

Pokud naopak zde máte uložená data, která již neplánujete používat ani stěhovat (například staré zálohy), prosíme, kontaktujte rovněž kolegy na du-support(at)cesnet.cz

Ivana Křenková, Mon Mar 04 15:35:00 CET 2024

Pozvánka na kurzy SVS FEM (Ansys)

Vážení uživatelé,

přeposíláme pozvánku s kurzy SVS FEM (Ansys):

|

|

SVS FEM s.r.o., Trnkova 3104/117c, 628 00 Brno

+420 543 254 554 | http://www.svsfem.cz

S přáním příjemného počítání,

Ivana Křenková, Thu Feb 01 23:40:00 CET 2024

Rušení diskových polí /storage/brno3-cerit/ a /storage/brno1-cerit/

Z důvodu poruchovosti a stáří jsme nedávno zrušili, nebo v dohledné době rušit plánujeme, stará disková pole Centra CERIT-SC:

• /storage/brno3-cerit/

• /storage/brno1-cerit/

Rušení /storage/brno3-cerit/

Nedávno jsme zrušili diskové pole /storage/brno3-cerit/ a data z /home adresářů jsme přesunuli do /storage/brno12-cerit/home/LOGIN/brno3 (alternativně přímo do /home, pokud byl na novém úložišti prázdný).

Dočasně zůstal funkční symlink /storage/brno3-cerit/home/LOGIN/…, který vede na stejná data na novém poli. Od nynějška prosím používejte novou cestu ke stejným datům /storage/brno12-cerit/home/LOGIN/…

Všechna data z brno3 jsou již fyzicky přestěhována na nové pole! Není potřeba nic nikam kopírovat.

Rušení /storage/brno1-cerit/

V blízké budoucnosti začneme stěhovat data z diskového pole /storage/brno1-cerit/ do /storage/brno12-cerit/home/LOGIN/brno1/.

Data přestěhujeme my, v době, kdy nebudou používána v úlohách.

Dočasně zůstane funkční symlink /storage/brno1-cerit/home/LOGIN/…, který povede na stejná data na novém poli. Ten bude po zrušení pole smazán a data budou dostupná jako /storage/brno12-cerit/home/LOGIN/brno1/.

POZOR na poli /storage/brno1-cerit/ jsou uložená také data z archivů starých, dávno zrušených diskových polí. Data z archivů neplánujeme přenášet automaticky! Pokud data z následujících archivů používáte, ozvěte se nám na meta@cesnet.cz, potřebná data překopírujeme rovněž do /storage/brno12-cerit/:

• /storage/brno4-cerit-hsm/

• /storage/brno7-cerit/

• /storage/jihlava1-cerit/

Výsledek

Jediným diskovým polem, připojeným do MetaCentra z Centra CERIT-SC, bude nadále /storage/brno12-cerit/ (storage-brno12-cerit.metacentrum.cz)

Všechna svá data najdete na diskovém poli /storage/brno12-cerit/home/LOGIN/… a symlinky na stará úložiště budou nejpozději v létě zrušeny.

S omluvou za komplikace a s přáním pěkného dne,

Vaše MetaCentrum

Ivana Křenková, Fri Jan 19 15:35:00 CET 2024

Pozvánka LUMI Intro Course

Vážení uživatelé,

přeposíláme pozvánku s kurzy v IT4Innovation.

|

||||||||||||

|

||||||||||||

|

S přáním příjemného počítání,

Ivana Křenková, Mon Jan 15 23:40:00 CET 2024

Novinky infrastruktury MetaCentrum & CERIT-SC

Novinky infrastruktury MetaCentrum & CERIT-SC

1) Přispěli jsme k projektu, který získal AI Awards 2023

Výzkumníci z Katedry kybernetiky FAV ZČU, kteří na jaře přednášeli na Gridovém semináři MetaCentra, a se kterými jsme nedávno připravili reportáž o využívání našich služeb, získali ocenění AI Awards 2023. Gratulujeme!

Za oceněným projektem zachování historického dědictví a kulturní paměti, který spočívá ve zpřístupnění archivu historických dokumentů NKVD/KGB, stojí také naše služby, zejména Kubernetes cluster Kubus a s ním spojená disková úložiště.

Tyto výpočetní a datové zdroje k řešení velmi náročných úloh spravuje pro oblast vědy a výzkumu MetaCentrum. Více informací v tiskové zprávě ZČU.

2) Účastníme se Czech Space Week

Náš kolega Zdeněk Šustr dnes vystupuje na konferenci Copernicus forum a Inspirujme se 2023 ve Hvězdáně a planetáriu v Brně. Představí nové služby, data a plány národního uzlu Sentinel CollGS a projekt GREAT. Konference je součástí akce Czech Space Week. Je zaměřena na dálkový průzkum Země a infrastruktury INSPIRE pro sdílení prostorových dat.

Projekt GREAT je financován z prostředků Evropské unie, programu Digital Europe Programme (DIGITAL – ID: 101083927).

Ivana Křenková, Thu Nov 30 15:35:00 CET 2023

Pozvánka na podzimní HPC kurzy

Vážení uživatelé,

přeposíláme pozvánku s kurzy v IT4Innovation.

|

|

|

|

|

|

|

S přáním příjemného počítání,

Ivana Křenková, Wed Jun 14 23:40:00 CEST 2023

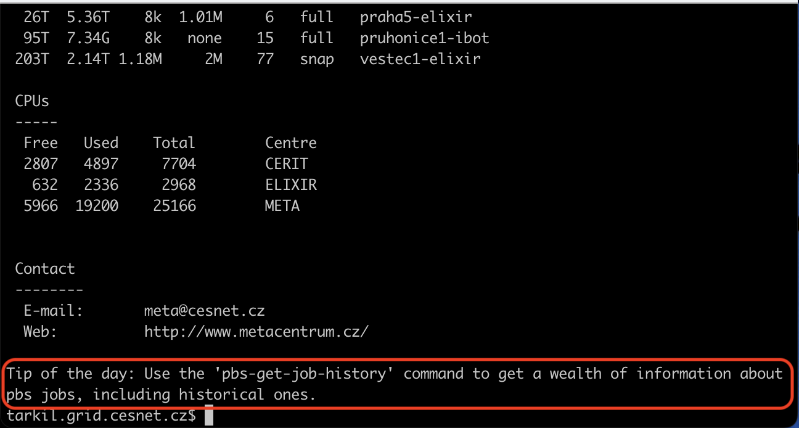

Tipy dne na frontendech

Vážení uživatelé,

na základě zpětné vazby, kterou jsme od Vás získali v uživatelském dotazníku z přelomu roku, jsme nejčastější dotazy zpracovali do podoby Tipu dne.

Nově se Vám zobrazí na všech frontendech náhodná rada v podobě krátkého textu na konci výpisu MOTD po přihlášení na frontend.

Zobrazování tipů si můžete na vybraném frontendu deaktivovat pomocí přikazu "touch ~/.hushmotd".

S přáním příjemného počítání,

Ivana Křenková, Wed Jun 07 23:40:00 CEST 2023

Nejpokročilejší systém pro AI a dva nové clustery pro náročné výpočty v MetaCentru

Vážení uživatelé,

s radostí oznamujeme, že jsme do MetaCentra pořídili nový velice zajímavý HW.

Více informací najdete také v tiskové zprávě e-INFRA CZ "Vědci v ČR získali nejpokročilejší systém pro AI a dva nové clustery pro náročné technické výpočty"

1) NVIDIA DGX H100

Masarykova univerzita (CERIT-SC) se stala průkopníkem v oblasti podpory umělé inteligence (AI) a výkonné výpočetní technologie díky instalaci nejnovějšího a nejvyspělejšího systému NVIDIA DGX H100. Jedná se o první zařízení tohoto typu v celé ČR (a Evropě), které přináší extrémní výpočetní sílu a inovativní možnosti pro výzkum.

Díky nejnovější architektuře GPU NVIDIA Hopper DGX H100 disponuje osmi pokročilými grafickými procesory NVIDIA H100 Tensor Core, každý s GPU pamětí 80 GB. Umožňuje tak paralelní zpracování obrovských datových objemů a výrazně urychluje výpočetní úlohy.

Konfigurace systému NVIDIA DGX H100 capy.cerit-sc.cz

- 8 GPU H100 80GB SXM5

- 135 168 CUDA jader

- 640 GB GPU paměti

- 2 TB RAM paměti

- 3,84 TB NVMe pro OS

- 30 TB NVMe pro data

- lokalita: Brno (CERIT-SC)

Server DGX H100 je dodáván s předinstalovaným softwarovým balíčkem NVIDIA DGX, který obsahuje komplexní sadu softwarových nástrojů pro hluboké učení, včetně předkonfigurovaných prostředí.

Stroj je přístupný na požádání ve speciální frontě gpu_dgx@meta-pbs.metacentrum.cz.

Pro přístup žádejte na adrese meta@cesnet.cz. V žádosti popište důvody pro přidělení tohoto zdroje (potřebnost a schopnost efektivního využítí. Zároveň popište stručně očekávané výsledky, předpokládaný objem zdrojů a časový rozsah potřebného přístupu.

2) Clustery TURIN a TYRA

Kromě toho mohou uživatelé MetaCentra začít využívat dva zcela nové výpočetní clustery, které pořídíl CESNET. První byl zprovozněn v Ústavu molekulární genetiky Akademie věd ČR v Praze-Krči pod názvem TURIN a druhý na Ústavu výpočetní techniky Masarykovy univerzity v Brně pod jménem TYRA.

Pražský cluster TURIN má 52 uzlů, z nichž každý disponuje 64 jádry CPU a 512 GB RAM. Jeho brněnský kolega TYRA je tvořen 44 uzly a jinak s totožnou technickou specifikací.

Oba clustery jsou osazeny procesory AMD společně s technologií AMD 3D V-Cache. Jde o nejvýkonnější serverové procesory určené pro náročné výpočty.

Konfigurace clusterů turin.metacentrum.cz a tyra.metacentrum.cz

- celkem 6144 jader CPU

- celkem 96 uzlů, každý má

- 64x AMD EPYC 7543@2.80GHz

- RAM: 512 GB

- disk: 7TiB NVME

- vlastník CESNET

- lokalita: Praha, Brno

- 10Gb uplink do páteřní sítě CESNET

Kompletní seznam aktuálně dostupných výpočetních serverů je na https://metavo.metacentrum.cz/pbsmon2/hardware.

S přáním příjemného počítání,

Ivana Křenková, Mon Jun 05 23:40:00 CEST 2023

Nový HW v MetaCentru

Masarykova univerzita (CERIT-SC) se stala průkopníkem v oblasti podpory umělé inteligence (AI) a výkonné výpočetní technologie díky instalaci nejnovějšího a nejvyspělejšího systému NVIDIA DGX H100. Jedná se o první zařízení tohoto typu v celé ČR, které přináší extrémní výpočetní sílu a inovativní možnosti pro výzkum.

Díky nejnovější architektuře GPU NVIDIA Hopper DGX H100 disponuje osmi pokročilými grafickými procesory NVIDIA H100 Tensor Core, každý s GPU pamětí 80 GB o celkovém výpočetním výkonu 32 TeraFLOPS. Umožňuje tak paralelní zpracování obrovských datových objemů a výrazně urychluje výpočetní úlohy. Díky vysoce výkonným paměťovým subsystémům v grafických akcelerátorech poskytuje rychlý přístup k datům a optimalizuje výkon při práci s velkými datovými sadami. Uživatelé tak mohou dosáhnout bezkonkurenční efektivity a odezvy ve svých AI úlohách.

Server DGX H100 je dodáván s předinstalovaným softwarovým balíčkem NVIDIA DGX, který obsahuje komplexní sadu softwarových nástrojů pro hluboké učení, včetně předkonfigurovaných prostředí.

Stroj je přístupný na požádání ve speciální frontě gpu_dgx@meta-pbs.metacentrum.cz.

Pro přístup žádejte na adrese meta@cesnet.cz. V žádosti popište důvody pro přidělení tohoto zdroje (potřebnost a schopnost efektivního využít). Zároveň popište stručně očekávané výsledky, předpokládaný objem zdrojů a časový rozsah potřebného přístupu.

Konfigurace NVIDIA DGX H100 (capy.cerit-sc.cz)

Kompletní seznam aktuálně dostupných výpočetních serverů je na http://metavo.metacentrum.cz/pbsmon2/hardware.

S přáním příjemného počítání,

Ivana Křenková, Thu Jun 01 23:40:00 CEST 2023

Nový HW v MetaCentru

MetaCentrum bylo rozšířeno o nové clustery:

1) CPU cluster turin.metacentrum.cz, 52 uzlů, 3328 jader CPU, s následující specifikací každého uzlu:

- CPU: 64x AMD EPYC 7543@2.80GHz

- RAM: 512 GiB

- disk: 2x3.84 TiB NVME

- Net: Ethernet 10 Gbit/s

- OS: Debian 11

- výkon každého uzlu je dle SPECrate 2017_fp_base = 516

- vlastník CESNET, Praha

2) CPU cluster tyra.metacentrum.cz, 44 uzlů, 2816 jader CPU, s následující specifikací každého uzlu:

- CPU: 64x AMD EPYC 7543@2.80GHz

- RAM: 512 GiB

- disk: 2x3.84 TiB NVME

- Net: Ethernet 10 Gbit/s

- OS: Debian 11

- výkon každého uzlu je dle SPECrate 2017_fp_base = 516

- vlastník CESNET, Brno

Clustery jsou dostupné v prostředí plánovacího serveru @pbs-meta prostřednictvím standardních krátkých front. Po otestování budou přidány i delší fronty.

Kompletní seznam aktuálně dostupných výpočetních serverů je na http://metavo.metacentrum.cz/pbsmon2/hardware.

S přáním příjemného počítání,

Ivana Křenková, Fri May 19 23:40:00 CEST 2023

Dokumentace MetaCentra se stěhuje

Vážení uživatelé,

připravili jsme pro Vás novou dokumentaci MetaCentra, která je dostupná na https://docs.metacentrum.cz/ .

Obsah jsme strukturovali podle témat, která Vás zajímají, ta najdete v horní liště. Po rozkliknutí vybraného tématu se rozbalí pomocné menu vlevo s další navigací. V pravo je pak obsah s tématy obsaženými na stránce.

Do přípravy dokumentace jsme promítli i zpětnou vazbu, kterou jste nám poslali v dotazníku (děkujeme). Například jsme pročistili spoustu neaktuálních informací, které zůstávaly dohledatelné ve wiki a pokusili jsme se zpřehlednit výukové příklady.

Kvůli možnosti zpětného dohledání informací nebude původní dokumentace smazána hned, ale zůstane dočasně přístupná. Od konce března 2023 však není aktualizována!

Proč jsme zvolili jiný formát dokumentace a opustili wiki?

Jak jistě víte, probíhá integrace poskytovaných služeb do jednotné platformy e-INFRA CZ*. Součástí této integrace je sjednocení formátu všech uživatelských dokumentací. Do budoucna naši novou dokumentaci začleníme do společné dokumentace všech poskytovaných služeb v rámci aktivit e-INFRA CZ https://docs.e-infra.cz/.

-----

* e-INFRA CZ je infrastruktura pro vědu a výzkum, která spojuje a koordinuje aktivity tří českých e-infrastruktur: CESNET, CERIT-SC a IT4Innovations. Více informací naleznete na domovské stránce e-INFRA CZ https://www.e-infra.cz/.

-----

Nová dokumentace stále prochází vývojem a změnami. V případě, že narazíte na jakékoliv problémy, nejasnosti nebo Vám něco chybí, dejte nám prosím vědět na e-mailu meta@cesnet.cz . Už teď přemýšlíme, jak pro Vás ještě lépe rozpracovat část dokumentace věnované instalacím SW.

S pozdravem,

tým MetaCentra

Ivana Křenková, Mon Apr 03 21:40:00 CEST 2023

Další kolo grantové soutěže v IT4Innovations Natinal Supercomputeing Center

Vážení uživatelé,

dovolujeme si přeposlat informaci o grantové soutěži v IT4I:

|

||||

|

Ivana Křenková, Thu Mar 30 21:40:00 CEST 2023

Pozvánka na hybridní školení Introduction to MPI

Vážení uživatelé,

dovolujeme si Vám přeposlat pozvánku na hybridní školení Introduction to MPI:

--

Dear Madam / Sir,

The Czech National Competence Center in HPC is inviting you to a course Introduction to MPI, which will be held hybrid (online and onsite) on 30–31 May 2023.

Message Passing Interface (MPI) is a dominant programming model on clusters and distributed memory architectures. This course is focused on its basic concepts such as exchanging data by point-to-point and collective operations. Attendees will be able to immediately test and understand these constructs in hands-on sessions. After the course, attendees should be able to understand MPI applications and write their own code.

Introduction to MPI

Date: 30–31 May 2023, 9 am to 4 pm

Registration deadline: 23 May 2023

Venue: online via Zoom, onsite at IT4Innovations, Studentská 6231/1B, 708 00 Ostrava–Poruba, Czech Republic

Tutors: Ondřej Meca, Kristian Kadlubiak

Language: English

Web page: https://events.it4i.cz/event/165/

Please do not hesitate to contact us might you have any questions. Please write us at training@it4i.cz.

We are looking forward to meeting you online and onside.

Best regards,

Training Team IT4Innovations

training@it4i.cz

Ivana Křenková, Tue Mar 14 21:40:00 CET 2023

Pozvanka na tradicni Seminar gridoveho pocitani - MetaCentrum

Vážení uživatelé,

Rádi bychom Vás pozvali na tradiční Seminář MetaCentra, který se bude konat v Praze 12. a 13. dubna 2023.

Společně s EOSC CZ jsme připravili bohatý program, který by Vás mohl zajímat.

První den akce bude věnován EOSC CZ aktivitám, především pak přípravě národní repozitářové platformy a ukládání/archivování výzkumných dat v ČR.

Druhý den pak proběhne Seminář gridového počítání 2023, který bude zaměřen na představení novinek a nových služeb, které MetaCentrum nabízí.

Mezi nimi budou například Singularity kontejnery, NVIDIA framework pro AI, Galaxy, grafická prostředí v OnDemand a Kubernetes, Jupyter Notebooky, Matlab (zvaná přednáška) a mnoho dalšího. Odpoledne se bude konat volitelný Hands-on workshop s omezenou kapacitou, kde si dozvíte mnoho zajímavého a pod vedením našich odborníků si můžete vyzkoušet témata, která Vás zajímají.

Protože chceme, aby Seminář odpovídal Vašim potřebám, budeme velmi rádi, když nám sdělíte, která témata Vás zajímají a co byste si chtěli vyzkoušet. Pokusíme se je zařadit do programu. Náměty prosím pište na meta@cesnet.cz.

Podrobnější informace a registraci najdete na stránce semináře: https://metavo.metacentrum.cz/cs/seminars/Seminar2023/index.html

Těšíme se na Vaši účast! Seminář proběhne v českém jazyce.

Vaše MetaCentrum

Ivana Křenková, Tue Mar 14 21:40:00 CET 2023

Nový způsob výpočtu fairshare

Vážení uživatelé,

rádi bychom vám oznámili, že od od čtvrtka 9. 3. 2023 se mění způsob výpočtu fairshare. Přidáváme nový koeficient s názvem "spec", který bere v úvahu rychlost výpočetního uzlu, na kterém běží úloha.

Dosud se "usage fairshare" počítal jako usage = used_walltime*PE , kde PE je "procesor ekvivalent" vyjadřující kolik zdrojů (ncpus, mem, scratch, gpu...) si uživatel na stroji alokoval.

Nově se bude počítat jako usage = spec*used_walltime*PE, kde "spec" značí koeficient, který vystihuje výkon hlavního uzlu (spec na jádro), na kterém běží úloha. Tento koeficient nabývá hodnot od 3 do 10.

Doufáme, že vám tato změna umožní ještě efektivnější využití našich výpočetních zdrojů. Pokud máte jakékoli dotazy, neváhejte nás kontaktovat.

Ivana Křenková, Tue Mar 07 21:40:00 CET 2023

Nová verze grafického rozhraní OnDemand

Vážení uživatelé,

připravili jsme novou verzi grafického prostředí OnDemand, které je dostupné nově na https://ondemand.metacentrum.cz

Open OnDemand je služba, která uživatelům umožňuje přístup k výpočetním zdrojům přes webový prohlížeč v grafickém režimu. Uživatel může spouštět běžné úlohy PBS, získat přístup k frontend terminálům, kopírovat soubory mezi našimi úložišti nebo spouštět několik grafických aplikací v prohlížeči. Mezi nejpoužívanější dostupné aplikace patří Matlab, ANSYS, MetaCentrum Remote Desktop a VMD (viz úplný seznam GUI aplikací dostupných přes OnDemand). Grafické relace jsou trvalé, můžete k nim přistupovat z různých počítačů v různých časech nebo dokonce současně.

Přihlašovací jméno a heslo do rozhraní Open OnDemand V2 je vaše přihlašovací jméno e-INFRA CZ / Metacentrum a heslo Metacentra.

Více informací najdete v dokumentaci: https://wiki.metacentrum.cz/wiki/OnDemand

Ivana Křenková, Mon Feb 13 21:40:00 CET 2023

Pozvánka na hybridní školení High Performance Data Analysis with R, 26–27

Vážení uživatelé,

dovolujeme si Vám přeposlat pozvánku na hybridní školení High Performance Data Analysis with R:

--

Dear Madam / Sir,

The Czech National Competence Center in HPC is inviting you to a course High Performance Data Analysis with R, which will be held hybrid (online and onsite) on 26–27 April 2023.

This course is focused on data analysis and modeling in R statistical programming language. The first day of the course will introduce how to approach a new dataset to understand the data and its features better. Modeling based on the modern set of packages jointly called TidyModels will be shown afterward. This set of packages strives to make the modeling in R as simple and as reproducible as possible.

The second day is focused on increasing computation efficiency by introducing Rcpp for seamless integration of C++ code into R code. A simple example of CUDA usage with Rcpp will be shown. In the afternoon, the section on parallelization of the code with future and/or MPI will be presented.

High Performance Data Analysis with R

Date: 26–27 April 2023, 9 am to 5 pm

Registration deadline: 20 April 2023

Venue: online via Zoom, onsite at IT4Innovations, Studentská 6231/1B, 708 00 Ostrava – Poruba, Czech Republic

Tutor: Tomáš Martinovič

Language: English

Web page: https://events.it4i.cz/event/163/

Please do not hesitate to contact us might you have any questions. Please write us at training@it4i.cz.

We are looking forward to meeting you online and onside.

Best regards,

Training Team IT4Innovations

training@it4i.cz

Ivana Křenková, Tue Jan 31 21:40:00 CET 2023

Poskytnutí zpětné vazby ke službám MetaCentra

Vážení uživatelé,

Rádi bychom se dozvěděli, co si myslíte o námi poskytovaných službách.

Najděte si prosím přibližně 15 minut na vyplnění formuláře pro zpětnou vazbu a poskytněte nám tak cenné informace potřebné pro rozvoj našich služeb.

Chápeme, že Váš čas strávený nad tímto dotazníkem je cenný, a proto každý, kdo formulář vyplní a bude mít vyplněné přihlašovací údaje do e-INFRA CZ, od nás obdrží odměnu v podobě 0,5 impaktované publikace, která navýší fairshare a zvýší prioritu uživatele v prostředí PBS.

Formulář pro zpětnou vazbu (vyberte prosím libovolnou jazykovou variantu):

Děkujeme vám za Vaši zpětnou vazbu. Přejeme Vám mnoho úspěchů a publikací i v roce 2023.

S pozdravem,

Vaše MetaCentrum

Ivana Křenková, Tue Jan 10 10:40:00 CET 2023

Nová fronta uv18.cerit-pbs.cerit-sc.cz na stroji ursa

Vážení uživatelé,

kvůli optimalizaci na NUMA systému serveru ursa byla zavedena fronta uv18.cerit-pbs.cerit-sc.cz, která umožňuje alokovat procesory pouze po nasobcích 18 tak, aby byl vždy využit celý NUMA node a nedocházelo k výraznému zpomalování výpočtu při zbytečné alokaci úlohy na více numa nodů.

Do fronty jsou proto přijímány pouze úlohy v násobcích 18 jader CPU a má vysokou prioritu.

S pozdravem,

Vaše MetaCentrum

Ivana Křenková, Tue Nov 29 10:40:00 CET 2022

Nový parametr PBS: spec

Vážení uživatelé,

nově je možné při žádosti o zdroje pro výpočetní úlohu zadat minimální rychlost CPU výpočetního nodu, t.j. zajistit, aby výpočetní uzel, na kterém úloha poběží, neměl procesor pomalejší než je určitá definovaná hodnota. Tento parametr se jmenuje spec a jeho číselná hodnota vychází z metodiky https://www.spec.org/ . Více k použití parametru spec se dočtete v naší uživatelské wiki na https://wiki.metacentrum.cz/wiki/About_scheduling_system#CPU_speed.

Vyžádání strojů s rychlejším procesorem může vést ke zkrácení výpočetní doby, na druhou stranu se tím omezuje množina nodů, kterou má úloha potenciálně k dispozici, a úloha tedy může čekat déle ve frontě. Používejte proto parametr spec s rozmyslem.

S pozdravem,

Vaše MetaCentrum

Ivana Křenková, Mon Aug 29 10:40:00 CEST 2022

Identifikace slabých hesel

Vážení uživatelé,

V rámci kontroly zabezpečení infrastruktury Metacentra jsme identifikovali

několik slabých uživatelských hesel. Aby byla zajištěna dostatečná ochrana

prostředí Metacentra, bude u příslušných uživatelů potřeba, aby provedli změnu

svého hesla na portále MetaCentra

(https://metavo.metacentrum.cz/cs/myaccount/heslo.html).

Uživatele, kterých se to týká, budeme kontaktovat přímo.

V případě dotazů se prosím obraťte na meta@cesnet.cz.

S pozdravem,

Vaše MetaCentrum

Ivana Křenková, Fri Aug 12 21:40:00 CEST 2022

Novinky infrastruktury MetaCentrum & CERIT-SC

Novinky infrastruktury MetaCentrum & CERIT-SC

1) Přístup he GUI aplikacím z prohlížeče

Uživatelé mohou nově přistupovat ke grafickému rozhraní aplikací proklikem přes webový prohlížeč. Návod na wiki https://wiki.metacentrum.cz/wiki/Remote_desktop#Quick_start_I_-_Run_GUI_desktop_in_a_web_browser.

Dřívější způsob přístupem přes VNC klienta je nadále možný - viz https://wiki.metacentrum.cz/wiki/Remote_desktop#Quick_start_II_-_Run_GUI_desktop_in_a_VNC_session a následující návody.

2) Historie uživatelských úloh

Uživatelé mohou nově získat historii svých úloh, včetně těch starších než 24 hodin, příkazem

pbs-get-job-history <job_id>

Pokud příkaz nalezne úlohu v archivu, vytvoří v aktuálním adresáři podadresář s názvem job_ID (např. 11808203.meta-pbs.metacentrum.cz), který obsahuje několik souborů. Důležité jsou zejména

job_ID.SC - kopie skriptu předaného příkazu qsub

job_ID.ER - standardní výstup úlohy (STDOUT)

job_ID.OU - standardní chybový výstup úlohy (STDERR)

Více informací je k dispozici v dokumentaci: https://wiki.metacentrum.cz/wiki/PBS_get_job_history

3) Nastavení paměti na GPU kartách

Na GPU kartách mohou nově uživatelé specifikovat, kolik nejméně paměti musí mít GPU karta k dispozici. K tomu slouží parametr gpu_mem. Například příkaz

qsub -q gpu -l select=1:ncpus=2:ngpus=1:mem=10gb:scratch_local=10gb:gpu_mem=10gb -l walltime=24:0:0

zařídí, aby se úloze přidělil stroj s GPU kartou, která má alespoň 10 GB paměti.

Více informací je k dispozici v dokumentaci https://wiki.metacentrum.cz/wiki/GPU_stroje

V souvislosti s tím bychom uživatele rádi upozornili, že pro specifikaci GPU karet je vhodnější používat kombinaci parametrů

gpu_mem a cuda_cap než název konkrétního klastru. Prvně uvedený způsob zahrne širší množinu strojů a tím pádem se zkrátí čekání úlohy ve frontě.

Ivana Křenková, Thu Aug 11 15:35:00 CEST 2022

Pozvánka na ESFRI Open Session

Vážení uživatelé,

dovolujeme si Vám přeposlat pozvánku na ESFRI Open Session

--

Dear All,

I am pleased to invite you to the 3rd ESFRI Open Session, with the leading theme Research Infrastructures and Big Data. The event will take place on June 30th 2022, from 13:00 until 14:30 CEST and will be fully virtual. The event will feature a short presentation from the Chair on recent ESFRI activities, followed by presentations from 6 Research infrastructures on the theme and there will also be an opportunity for discussion. The detailed agenda of the 3rd Open Session will soon be available via the event webpage.

ESFRI holds Open Sessions at its plenary meetings twice a year, to communicate to a wider audience about its activities. They are intended to serve both the ESFRI Delegates and representatives of the Research Infrastructures community, and facilitate both-ways exchange. ESFRI has launched the Open Session initiative as a part of the goals set within the ESFRI White Paper - Making Science Happen.

I would like to inform you that the Open Session will be recorded and will be at your disposal at our ESFRI YouTube channel. The recordings from the previous Open Sessions themed around the ESFRI RIs response to the COVID-19 pandemic, and the European Green Deal, are available here.

Please forward this invitation to your colleagues in the EU Research & Innovation ecosystem that you deem would benefit from the event.

Registration is mandatory for participation, and should be done via the following link:

https://us06web.zoom.us/webinar/register/WN_0-sM43ktT3mPuCzXi3KNdQ

Your attendance at the Open Session will be highly appreciated.

Sincerely,

Jana Kolar,

ESFRI Chair

Ivana Křenková, Mon Jun 20 21:40:00 CEST 2022

Pozvánka na Seminář gridového počítání 2022 + Konference e-INFRA CZ

Vážení uživatelé,

Dovolujeme si Vás tímto pozvat k účasti na Seminář gridového počítání - MetaCentrum 2022, který se koná 10. května 2022 v Praze v hotelu Diplomat.

Seminář je součástí konference e-infrastruktury e-INFRA CZ 2022 https://www.e-infra.cz/konference-e-infra-cz

Představíme Vám infrastrukturu e-INFRA CZ, její služby, mezinárodní projekty a výzkumné aktivity. Seznámíme vás s aktuálními novinkami a nastíníme naše plány.

V odpoledním programu vám nabídneme dvě paralelní sekce. Jedna se zaměří na rozvoj sítě, její bezpečnost a multimédia a druhá na zpracování a ukládání dat - Seminář gridového počítání MetaCentrum 2022.

V podvečer se pak zájemci mohou zúčastnit bonusové sekce Gridová služba MetaCentrum - Best Practices s následnou volnou diskuzí o tématech, která Vás zajímají a nedají Vám spát.

Více informací, program a registraci najdete na stránce akce https://metavo.metacentrum.cz/cs/seminars/seminar2022/index.html

Na shledanou se těší Vaše MetaCentrum

Ivana Křenková, Mon Apr 18 21:40:00 CEST 2022

Nový HW v MetaCentru

MetaCentrum bylo rozšířeno o nové clustery:

1) GPU cluster

galdor.metacentrum.cz vlastník CESNET, 20 uzlů, 1280 jader CPU a 80 GPU kartami NVIDIA A40, s následující specifikací každého uzlu:

- CPU: 64x AMD EPYC 7543

- RAM: 512 GiB

- GPU: 4x NVIDIA A40

- disk: 2x7.68 TiB NVME

- Net: x Ethernet 10 Gbit/s

- OS: Debian 11

- výkon každého uzlu je dle SPECfp2017: 513 (8 na jádro)

Cluster je dostupný v prostředí plánovacího serveru @pbs-meta prostřednictvím standardních krátkých front a prioritní fronty gpu.

Na GPU clusterech je možné využívat dockerové obrazy z NVIDIA GPU Cloud (NGC) -- nejpoužívanější prostředí pro vývoj machine learning a deep learning aplikací, HPC aplikací nebo vizualizaci akcelerovanou NVIDIA GPU kartami. Nasazení těchto aplikací je pak otázkou zkopírování odkazu na příslušný Docker obraz, jeho spuštění spuštění v Docker kontejneru v Singularity. Více informací najdete na https://wiki.metacentrum.cz/wiki/NVidia_deep_learning_frameworks

2) CPU cluster

halmir.metacentrum.cz vlastník CESNET, 31 uzlů, 1984 jader CPU, s následující specifikací každého uzlu:

- CPU: 64x AMD EPYC 7543

- RAM: 1024 GiB

- disk: 2x7.68 TiB NVME

- Net: Ethernet 10 Gbit/s

- OS: Debian 11

- výkon každého uzlu je dle SPECfp2017: 513 (8 na jádro)

Cluster je dostupný v prostředí plánovacího serveru @pbs-meta prostřednictvím standardních krátkých front. Po otestování budou přidány i delší fronty.

Kompletní seznam aktuálně dostupných výpočetních serverů je na http://metavo.metacentrum.cz/pbsmon2/hardware.

Problémy s kompatibilitou některých aplikací s OS Debian11 průběžně řešíme rekompilací nových SW modulů. Pokud narazíte na problém u své aplikace, vyzkoušejte přidání modulu debian10-compat na začátek spouštěcího skriptu. Pokud problémy přetrvávají, dejte nám vědět na meta(at)cesnet.cz.

S přáním příjemného počítání,

Ivana Křenková, Fri Mar 11 23:40:00 CET 2022

Pozvánka na webinář Kubernetes

Vážení uživatelé,

zveme Vás na webinář Představení Kubernetes jako další výpočetní platformy dostupné uživatelům MetaCentra

Kdy: pátek 18. 3. 2022, 13 –15 hodin

Kde: online, platforma ZOOM, pozvánka bude zaslána před akcí registrovaným zájemcům

Pro koho: uživatelé MetaCentra

Jazyk: čeština

Lektor: RNDr. Lukáš Hejtmánek, Ph.D., Masarykova univerzita, CERIT-SC

Co se dozvíte

- Seznámení s Kubernetes [PDF].

- Praktické ukázky https://docs.cerit.io/docs/webinar1.html

- Webové aplikace pouštěné z Kubernetes – Jupyter a Binder Hub.

- Dostupné aplikace pro interaktivní práci – Ansys, Matlab, RStudio.

- Některou si ukážeme v praktické ukázce.

- Ukázka spuštění vlastní aplikace.

Technické požadavky

- Pro webové aplikace postačuje běžný prohlížeč.

- Pro vyzkoušení Ansys/Matlab je nutný vncviewer (realvnc, turbovnc), pro uživatele Mac OS stačí Safari browser.

- Pro ukázku vlastní aplikace je nutná možnost nainstalovat nástroj kubectl (bude ukázáno na webináři) a znalost běžné práce s terminálem.

Záznam z webináře https://youtu.be/zUrkd5qmbAc

Dokumentace ke Kubernetes a Rancheru https://docs.cerit.io/

Ivana Křenková, Tue Mar 08 21:40:00 CET 2022

Nové algoritmy autentizace uživatelů

Vážení uživatelé,

v infrastruktuře MetaCentrum pokračujeme v přechodu na nové algoritmy používané pro autentizaci uživatelů a ověření jejich hesel.

Nové algoritmy jsou bezpečnější a přináší podporu nových zařízení a operačních systémů. Pro dokončení přechodu bude u některých uživatelů potřeba, aby provedli nové zadání svého hesla v aplikaci pro změnu hesla na portále Metacentra (https://metavo.metacentrum.cz/cs/myaccount/heslo.html).

Uživatele, kterých se to týká, budeme kontaktovat přímo.